项目资料与详细内容获取说明

为便于评审专家与读者全面了解本项目的设计思路、技术实现与实际效果,我们提供了多平台的详细资料入口,涵盖技术解析、系统演示与完整代码实现。通过这些资源,可以从不同维度深入理解本项目的整体架构与创新点。

- 首先,在技术文档方面,我们在CSDN平台发布了完整的项目解析文章,系统性介绍了项目背景、核心功能设计、多模态模型架构以及前后端实现逻辑。该文章对系统中的关键技术模块进行了逐层拆解,便于读者从工程实现与算法设计两个层面理解项目整体方案。

访问链接 👉 - 其次,在系统演示方面,我们提供了完整的DEMO视频,展示了项目从音乐输入、分析处理、对话交互到音乐生成与多模态融合的完整流程。视频通过真实操作演示系统功能,并结合讲解说明,使观众能够直观理解系统的使用方式与实际效果。

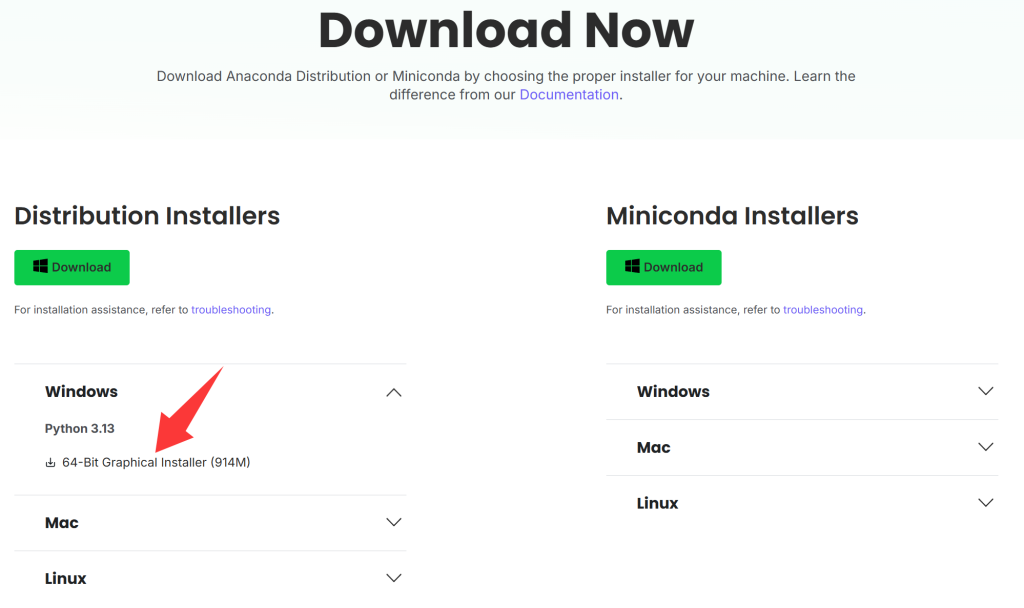

访问链接👉 - 最后,在代码开源方面,我们将项目核心实现发布在GitHub平台,包含前端(Vue)、后端(Django)以及模型调用与系统调度逻辑。通过开源仓库,开发者可以进一步复现系统功能,或在此基础上进行扩展与研究。该仓库集中体现了系统在多Agent协同、多模态处理与工程化实现方面的具体细节。

访问链接👉

总体而言,上述资源从“理论解析—系统演示—代码实现”三个层面构建了完整的信息闭环,不仅增强了项目的可验证性与透明度,也为后续研究与应用提供了良好的基础支持。

一、项目概述

本项目是在团队既有成果“心灯——AI数字疗愈平台”的基础上进一步拓展形成的创新系统。心灯项目由华东师范大学联合上海市卫生健康统计中心、长宁区精神卫生中心共同推进,围绕精神卫生领域的数字化转型需求,构建了面向情绪干预的多智能体协同系统。团队成员来自计算机科学与技术学院、药学院以及心理与认知科学学院,形成了“人工智能+心理学+医学”的融合研究体系。项目由中国工程院院士钱旭红进行总体指导,并由国家杰出青年、华东师范大学药学院院长李洪林教授与计算机科学与技术学院副院长贺樑教授提供学术支持。该系统在腾讯架构师的支持下,经历18个月迭代,形成从V1到V7的产品演进路径,并在微信小程序、iOS应用及研究平台中实现部署,累计服务用户超过千人,留存用户超过百人,具备较为扎实的工程基础与真实场景验证能力。

图1.1 心灯发布会媒体图

此外,系统正在申请医疗器械许可证注册,并在华东师范大学、长宁区精神卫生中心进行应用验证,与数药智能、上海市第五人民医院、吉利汽车苏州研究院等机构形成合作意向。在2025年世界冥想日,该系统一经发布,获得新浪财经等多家媒体报道。这些前期成果为本项目提供了坚实的技术与应用基础,推动冥想进入“智能辅助时代”,让无量化的“玄学”真正转向跨学科的“科学”。

图1.2 心灯安卓APP端和VR眼镜体验图

在上述基础之上,本项目进一步引入音乐理解与生成能力,将传统数字疗愈从语言交互拓展至音乐驱动的多模态交互,从而形成一个以音乐为核心媒介的情绪干预系统。该系统面向当前精神健康服务中普遍存在的供需失衡、个性化不足以及干预时效性弱等问题,通过人工智能技术构建随时可用、主动引导、沉浸交互的新型服务模式。与此同时,项目紧密结合国家“健康中国2030”战略与“人工智能+医疗卫生”发展方向,旨在探索数字疗法在真实应用场景中的可行路径与技术边界。

因此,本项目的核心目标在于构建一个融合音乐理解、生成与交互能力的智能系统,使人工智能不仅能够分析与生成音乐内容,更能够参与到用户情绪调节过程中,成为一种具备实际疗愈价值的数字化工具。这一目标的实现,标志着AI技术从信息处理工具向情绪干预媒介的重要转变。

二、作品描述

在整体系统设计上,本项目围绕“音乐理解—音乐生成—情绪调节—沉浸交互”构建了多层次功能体系,使各模块之间形成逻辑闭环,从而保证系统既具备功能完整性,又具备良好的用户体验连续性。

2.1 音乐理解和多功能分析

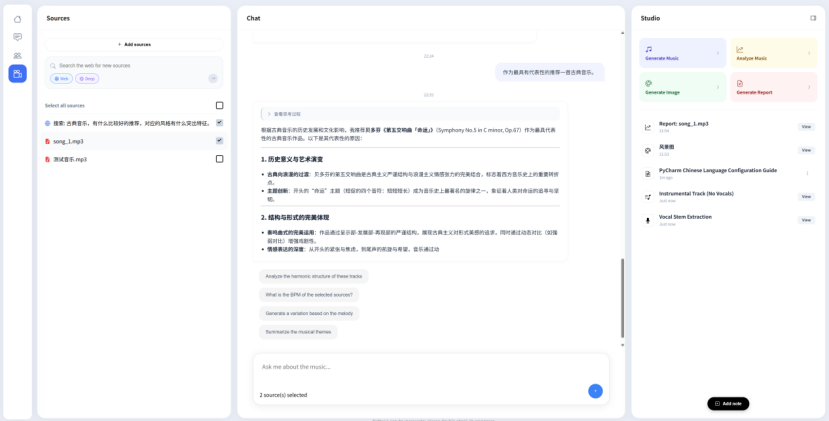

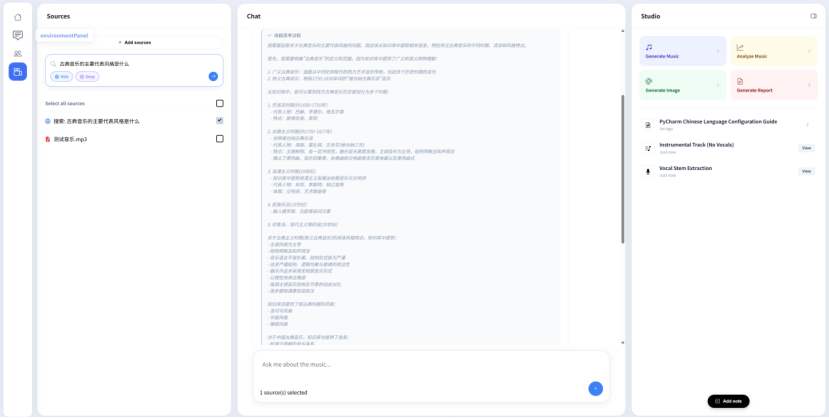

首先,在音乐理解与交互层面,系统支持用户输入本地音乐文件或调用网络在线的音乐资源,并基于此开展多维度分析与对话。具体而言,系统能够自动解析音乐的和弦结构、节拍特征、调式信息及风格属性,同时在分析过程中实现人声与伴奏的自动分离。该过程采用后台异步机制执行,并支持结果下载,从而在保证分析精度的同时提升Web端的使用效率。进一步地,系统支持多首音乐的联合输入,并生成结构化对比报告,从多个音乐学维度揭示不同作品之间的差异性,这一功能有效增强了用户对音乐内容的理解深度。

图2.1 多维感官意图注入与智能分析界面图

在此基础上,系统引入音乐对话机制,使用户能够围绕特定音乐展开连续交互。为了提升交互质量,系统提供Fast模式与Think模式两种推理路径,分别对应快速响应与深度分析场景。同时,系统支持在线与离线双模式运行,使其在不同网络环境下均具备稳定表现。值得强调的是,在每一轮对话结束后,系统会基于当前上下文自动生成四个潜在问题建议,从而引导用户进一步探索。这一设计改变了传统被动问答模式,使系统具备主动引导能力,显著增强了交互连贯性与用户参与感。

图2.2 基于在线检索的Think模式深度推理与解析界面

2.2 多Agent协同音画疗愈

在音乐生成与情绪调节层面,系统引入以用户状态为核心的生成机制。用户可以输入当前情绪、调节目标、身体状态以及偏好音乐元素,系统据此生成个性化音乐内容。这一过程不仅实现了音乐生成的定制化,也使生成结果具备明确的情绪调节导向。为了提升生成效果,本项目对TangoFlux音乐生成模型进行了定向微调,并引入华东师范大学计算机学院与上海音乐学院联合采集的疗愈音乐数据,使模型能够更好地适应特定心理干预场景。这一改进显著增强了生成音乐在实际疗愈应用中的有效性。

与此同时,系统通过调用Unsplash API获取与用户输入语义一致的图像内容,并将其与生成音乐进行融合展示,从而构建“音画一体”的多模态体验。该设计使用户在听觉与视觉两个维度同时获得情绪引导,进一步提升沉浸感与疗愈效果。

图2.2 多维度的智能分析音画疗愈展示图

2.3 手势例子音乐可视化图

在交互体验层面,项目进一步提出沉浸式手势音乐粒子模块。该模块结合计算机视觉与实时三维渲染技术,通过摄像头捕捉用户手势信息,并将其映射为对粒子系统的控制信号。在具体实现中,系统利用音乐低频信号驱动约40,000个粒子的动态变化,并通过手势实现粒子形态与运动的实时调控。系统整体帧率稳定在60FPS,从而保证了交互过程的流畅性。这一模块实现了听觉、视觉与肢体动作之间的深度融合,使用户在交互过程中形成更强的沉浸体验,同时也拓展了音乐疗愈的表达形式。

图2.3 手势控制与音乐可视化图

此外,系统还设计了环境自适应UI机制。通过调用高德地图接口获取用户所在地区的天气与气温信息,系统能够动态调整界面风格,并将环境信息作为生成模型的输入条件之一。例如,在晴天条件下,系统倾向于生成色彩明亮、节奏轻快的音乐与图像,而在阴雨环境下则生成更加柔和与舒缓的内容。该机制使系统具备一定的情境感知能力,从而进一步提升个性化程度与用户体验一致性。

三、技术创新点

3.1 数据集清理和大模型构建

在技术层面,本项目的创新性体现在多个关键环节的协同突破,而非单一模型性能的提升。首先,在音乐理解方面,系统采用由NVIDIA Applied Deep Learning Research(ADLR)团队于2025年11月发布的音乐问答模型Music Flamingo。该模型能够在音乐语义层面进行推理,使系统不仅能够处理音频信号,还能够理解音乐背后的结构与表达,从而支撑高质量对话能力。

其次,在音乐生成方面,项目采用了NVIDIA在ICLR 2026发表的音频生成模型TangoFlux作为基础框架,并结合上海音乐学院支持的疗愈音乐数据进行微调。这一方法在保持生成质量的同时,使模型能够适应疗愈场景需求,从而实现“生成质量”与“应用价值”的统一。通过引入真实疗愈场景数据,模型不仅在音质与结构上达到较高水平,同时在情绪引导与心理干预方面表现出更强的针对性,显著提升了系统在实际应用中的有效性。

图3.1 基于专属疗愈数据集的跨模态视觉生成展示图

在此基础上,本项目进一步在图像生成与跨模态对齐方面进行了拓展,构建了音乐与视觉协同生成能力。依托于华东师范大学计算机学院提出并构建的国内首个多维疗愈音画数据集,共包含7201条高质量音画数据对,并对图像进行三维标签标注(包括情绪维度、语义内容与视觉风格),从而为多模态生成提供精细化监督信号。基于该数据集,系统能够根据音乐内容生成与之匹配的视觉表达,实现音画之间的语义一致性与情绪一致性。这一能力不仅增强了用户的沉浸式体验,也为音乐疗愈提供了更具表现力的多模态载体。

第三,在系统核心推理能力上,项目基于NVIDIA NeMo框架构建整体模型体系,并选用NVIDIA开源的大语言模型NemoTron-3 Nano作为核心引擎。该模型在保证推理效率的同时具备较强的语言理解与生成能力,使系统能够在复杂多模态任务中保持稳定表现。

更为重要的是,本项目将上述模型能力整合为统一系统,构建了从音乐输入到情绪输出的完整闭环。这种“理解—生成—反馈”的结构,使系统能够持续根据用户状态进行调整,从而形成动态优化过程。相比传统单点模型应用,该系统在整体性与实用性上均具有显著优势。

此外,团队在相关技术方向上已形成系统性科研积累与知识产权布局,围绕多模态生成与理解已申请发明专利十余项,包括“一种基于多模态交叉注意力与动态特征融合的音乐生成方法”、“一种基于图神经网络的图像布局属性预测方法”和“一种基于有向无环图网络的方面级情感分类方法”等。这些成果从算法结构、特征建模与多模态融合等多个层面支撑了本项目的技术实现,进一步增强了系统的创新性与可持续发展能力。

图3.2 多模态核心算法与知识产权专利图

在计算资源方面,项目部署于GB10服务器环境中,利用GPU加速实现低延迟推理与高并发处理能力。这一技术路径不仅保证了系统性能,也为后续规模化部署提供了可行基础。通过上述技术整合,项目在效率、稳定性与扩展性方面均达到较高水平。

3.2 前后端框架概述

本项目在前端技术选型与工程实现上并非简单堆叠工具,而是围绕多模态交互场景进行了系统性整合与深度开发。通过将音频处理、三维渲染、实时对话、环境感知与状态管理等多类技术有机融合,前端不仅承担了界面展示功能,更实现了复杂交互逻辑与多模态数据流的统一调度。这种跨技术栈的协同设计显著提升了系统的交互深度与沉浸体验,同时也带来了较高的工程实现复杂度与开发工作量。整体来看,该部分工作体现了从“功能实现”向“系统级交互设计”的转变,是项目创新性的重要组成部分。

表3.1 前端技术栈

| 技术 | 用途 | 技术 | 用途 |

| vue | 前端核心框架 | vue-router | 路由管理器 |

| @amap/amap-jsapi-loader | 高德地图加载器 | marked | Markdown解析器 |

| bootstrap-icons | Bootstrap图标库 | node-vibrant | 图片主色提取 |

| lucide-vue-next | 现代图标组件库 | pinia | Vue状态管理库 |

| three | 三维渲染引擎 | wavesurfer | 音频波形可视化 |

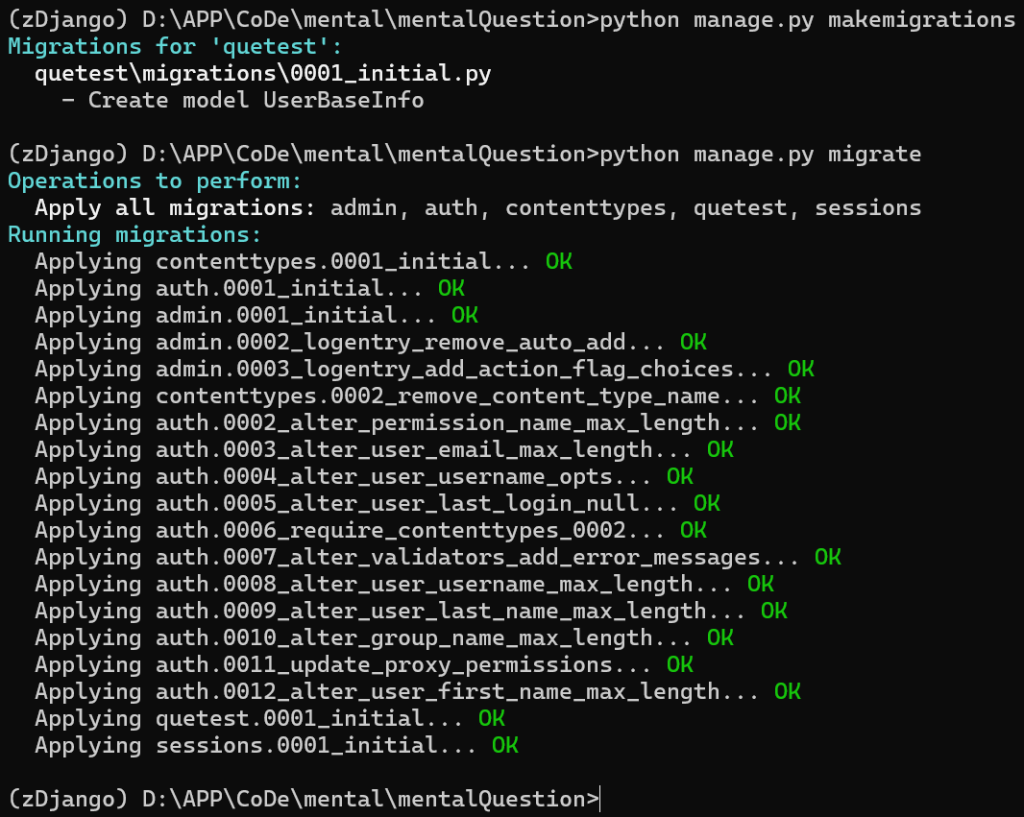

在后端实现方面,本项目基于Django框架构建统一服务架构,承担模型调度、任务管理与数据处理等核心功能。后端不仅负责基础的接口开发,还需要对接多种复杂AI模型,包括音乐理解模型Music Flamingo、音频生成模型TangoFlux以及基于NVIDIA NeMo框架构建的大语言模型NemoTron-3 Nano,从而实现多模型协同推理与统一调用。在此过程中,系统设计了标准化的模型接口与任务调度机制,使不同类型的推理请求能够被统一管理与高效执行。

图3.3 多维感官意图注入与音乐智能分析系统总体架构及业务逻辑图

针对音乐分析、音频生成与多模态处理等高耗时任务,后端实现了异步任务处理与队列机制,有效避免阻塞问题,并支持任务状态跟踪与结果回调,保障前端交互的流畅性。同时,系统对音频文件上传、处理与存储流程进行了完整设计,包括人声分离、特征提取与结果文件生成等多个环节,涉及较为复杂的数据处理链路。此外,后端还集成在线搜索能力与外部API调用,使模型能够获取实时信息并参与推理过程,从而增强系统整体能力。

在系统工程层面,后端需要支撑高并发请求与大规模模型推理任务,因此在部署上结合GPU服务器环境,对推理流程进行了性能优化与资源调度设计。这不仅提升了系统响应速度,也为后续扩展提供了基础。总体而言,后端部分不仅承担了基础服务职责,更在多模型协同、异步调度与复杂数据处理等方面投入了大量工程工作,是支撑整个系统稳定运行与功能实现的关键核心。

该系统整体采用分层架构设计,如图3.3所示,从上至下形成“用户交互—核心处理—数据支撑”的完整闭环。在用户交互层,系统通过Web前端统一承载多种输入方式,包括本地音频上传与在线音乐资源接入,并提供多种分析模式选择,使用户能够根据需求灵活切换单曲分析或多曲对比。同时,交互界面嵌入对话能力与推理模式控制(Fast/Think),并通过自动问题推荐机制,引导用户逐步深入探索,形成连续且具引导性的使用体验。

在核心处理层,系统围绕“音频解析—多维分析—对话推理”构建关键流程。音频输入首先进入异步分析引擎,完成包括人声伴奏分离与多维音乐特征提取在内的复杂处理过程,随后生成结构化分析结果与对比报告。与此同时,对话与推理模块对用户意图进行解析,并根据不同模式调用快速响应或深度推理路径,同时结合在线检索增强结果质量。底层的数据与资源层则为整个系统提供支撑,包括本地数据库、在线音乐接口以及多维度知识库,从而保证系统在分析准确性与信息丰富度上的稳定表现。整体流程体现出从输入感知到智能处理再到结果反馈的闭环逻辑,具有良好的扩展性与工程完整性。

四、团队贡献

在具体分工方面,张子昊主导智能音乐对话与多模态分析与个性化疗愈音乐生成的研发,并攻克了基于NVIDIA NeMo框架的大模型交互、音乐QA/生成模型集成、疗愈微调训练及Unsplash视觉联动,同时完成前端整体架构与UI逻辑;施景瑞负责沉浸式手势音乐粒子交互,利用计算机视觉与3D渲染技术,实现高帧率手势识别及40,000粒子实时音乐驱动,打造非接触式视听触联动体验;项征构建稳定高效的人声伴奏分离、异步任务处理、文件下载服务。团队在AI算法、前端交互与后端工程上优势互补、无缝衔接,成功将四大模块融合为完整的全模态音乐平台,充分彰显了卓越的跨端协作与团队精神。

五、未来展望

在未来发展方面,本项目将围绕“技术深化、临床验证与规模化推广”三个方向持续推进。首先,在技术层面,系统将进一步引入脑电、心率变异性等生理信号,实现更加精准的情绪识别与个性化干预,从而提升疗效评估的客观性与可靠性。

其次,在应用层面,项目将完善移动端与微信小程序部署,提升系统的可访问性与用户规模。同时,通过持续优化模型结构与推理效率,进一步降低使用成本,使其能够覆盖更广泛人群。

在医疗转化方面,项目将推进随机对照试验(RCT)等临床研究,积累循证医学证据,并逐步向医疗器械注册与医保体系接入迈进,从而实现从科研成果到医疗产品的转化路径,目前正在进行医疗器械注册申请。

总体而言,本项目不仅在技术上实现了多模态音乐AI系统的创新整合,更在应用层面探索了数字疗法的新范式。其核心意义在于证明人工智能可以从“辅助工具”演进为“可参与情绪调节的主动系统”,从而为精神卫生领域提供一种具有可持续性与可扩展性的解决方案。